El magnate quiere construir una alternativa a ChatGPT, con una inteligencia artificial generativa que no tenga interés en destruir a la civilización humana, sino comprender la verdadera naturaleza el universo

- 4 minutos de lectura'

Bastaron menos de 10 palabras para que Elon Musk anunciara un nuevo emprendimiento. El magnate ha entrado al negocio de la inteligencia artificial con xAI, una nueva compañía que, en su opinión, ayudará a “comprender la realidad” y la naturaleza del universo. La empresa se ha estrenado en las redes sociales lanzando una pregunta de corte filosófico: “¿Cuáles son las preguntas más fundamentales que permanecen sin respuesta?”. Es el más reciente golpe de efecto del hombre más rico del mundo, quien vive horas bajas en Twitter, la plataforma que compró el año pasado y cuya existencia se ha visto amenazada tras el lanzamiento de Threads, respaldada por el gigante tecnológico Meta.

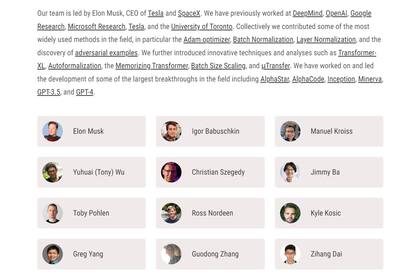

El equipo de xAi ha presentado este miércoles a través de una página web. Está encabezado por Musk y formado por otros 11 ingenieros, todos hombres, quienes tienen experiencia en proyectos como DeepMind de Google, OpenAI y Microsoft. Son talentos que han ayudado a desarrollar las versiones 3.5 y 4 de ChatGPT, que ha significado un antes y un después en el sector con más de 100 millones de suscriptores en los primeros dos meses tras su lanzamiento. El equipo hará su presentación oficial este viernes en una charla en Spaces, de Twitter. El anuncio ha dejado claro que están contratando nuevos perfiles.

No es la primera vez que Musk se interesa en la inteligencia artificial. El empresario lleva más de diez años apostando por el desarrollo de herramientas de este tipo, algunas de estas ya están en funcionamiento en Tesla. Pero ha sido en los meses recientes y, sobre todo, a raíz del éxito de ChatGPT que ha decidido pisar el acelerador. En marzo, él y su socio, Jared Birchall, registraron el nombre de la compañía ante las autoridades de Nevada. Un mes después, ya estaba en negociaciones para convencer a los inversionistas de su empresa automotriz y de SpaceX para hacerse de recursos frescos para inyectar en xAI. De acuerdo al diario Financial Times, Musk compró miles de procesadores de Nvidia, una empresa que se disparó en bolsa por el boom de la inteligencia artificial.

El dueño de Tesla y SpaceX estuvo vinculado con OpenAI, la empresa que lanzó el robot ChatGPT. Musk abandonó la junta del consejo de la compañía en 2018. Desde entonces, ha criticado abiertamente a la empresa, a quien ha calificado de estar en manos de Microsoft, que ha invertido 13.000 millones de dólares en el desarrollo del chatbot.

A finales de marzo, la de Musk fue una de las voces más relevantes en medio de un coro de la industria que pidió cautela en la nueva ola de AI. A través de una carta abierta, expertos y ejecutivos de tecnológicas pidieron una tregua de seis meses para pausar el avance de las investigaciones. El argumento era que estas herramientas representan “profundos riesgos para la sociedad y la humanidad”. El documento hacía referencia a las reglas del juego adoptadas por varios desarrolladores y capitanes de industria en 2017 en una conferencia convocada por el instituto Future of Life. Estas acordaban dedicar un intenso cuidado a los recursos éticos y económicos invertidos en los bots ante la profunda capacidad que tienen para “cambiar la historia de la vida en la tierra”.

El lanzamiento de xAI parece atender a estas preocupaciones. Además del equipo de 12 hombres que conforma la nueva empresa, la compañía ha sumado también a Dan Hendrycks, un doctor de Berkeley que dirige el Centro para la Seguridad de la Inteligencia Artificial (CAIS, por las siglas en inglés). Es una organización sin fines de lucro basada en San Francisco que investiga el desarrollo del sector y se enfoca en reducir potenciales daños para la sociedad. La organización ofrece becas para estudiar filosofía e imparte cursos que ayuden a detectar anomalías en la programación, entre otros elementos.

Hendrycks, junto con otros dos autores, explicaba en un ensayo reciente publicado por la universidad de Cornell que existen cuatro grandes categorías en las que la IA puede representar un daño a la sociedad. La primera es que grupos o individuos utilicen la herramienta con malas intenciones. La segunda es la carrera entre compañías por desarrollar, que puede provocar que la prisa o las presiones de inversionistas pongan a disposición de los usuarios versiones inacabadas o imperfectas que otorguen demasiado control a los algoritmos. La tercera son los riesgos organizacionales, cómo la interacción de errores humanos y sistemas complejos pueden tener como resultado “accidentes catastróficos”. La última es quizá la más temida, los programas que aprovechen una inteligencia muy superior a la humana para rebelarse contra la sociedad. “Nuestro objetivo es promover una profunda comprensión de estos riesgos e inspirar esfuerzos colectivos para asegurarnos de que la IA sea empleada de forma segura”, dice Hendrycks en el ensayo.

EL PAIS

EL PAISOtras noticias de Inteligencia artificial

1

1Renault Gordini modelo 2025: así sería el histórico vehículo, según la IA

2

2Histórico: China repavimentó casi 160 km de autopista con máquinas autónomas

3

3Se termina el Impuesto PAIS: cuánto costará un iPhone en el exterior desde diciembre 2024

4

4Las 5 señales que muestran que tenés una mentalidad positiva, según un análisis de IA