La herramienta de inteligencia artificial de OpenAI no ha corregido sus sesgos algorítmicos, por lo que tiende a dibujar a hombres blancos con mejores profesiones que mujeres y personas racializadas

8 minutos de lectura'

8 minutos de lectura'

Las redes sociales se han visto inundadas en las últimas semanas por unos dibujos de tintes surrealistas generados por una herramienta automática. Son obra de Dall-E Mini, la versión de bolsillo de un sofisticado sistema de inteligencia artificial capaz de traducir las instrucciones escritas del usuario en imágenes originales. Desarrollada por OpenAI, una empresa impulsada por Elon Musk, la herramienta ha sido entrenada con varios millones de imágenes asociadas a un texto.

El programa es capaz de establecer relaciones y arrojar nueve propuestas distintas cada vez que se le pide algo. En cuanto se introducen las palabras clave, como por ejemplo “Bill Gates sentado bajo un árbol” (aunque siempre en inglés, el único idioma que computa por ahora), el sistema busca en tiempo real imágenes sacadas de internet relacionadas con cada palabra y crea a partir de ahí sus propias composiciones. Arroja siempre creaciones originales, si bien las de su hermano mayor, Dall-E 2, son mucho más sofisticadas.

Los internautas se lo están pasando en grande con la versión Mini de la herramienta, abierta al público. La cuenta de Twitter Weird Dall-E Mini Generations recoge incontables ejemplos graciosos. Por ejemplo, Boris Johnson como el sol de los Teletubbies o Sonic como artista invitado en un capítulo de la serie Friends. Se han viralizado ejemplos patrios con Bertín Osborne o Santiago Abascal como protagonistas en situaciones cómicas o indecorosas. Al funcionar con una base de datos sacada de internet, el sistema es especialmente bueno cuando se le solicitan dibujos que incluyan a personajes conocidos (y, por tanto, más representados en la Red).

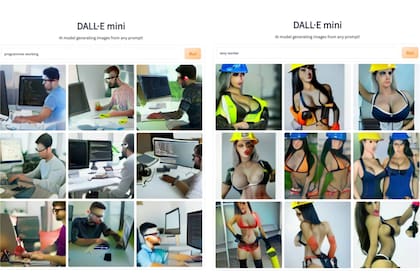

Pero debajo de esta capa de aplicación amable, divertida y fascinante subyace otra un tanto más oscura. Pese a que en inglés muchas profesiones no incluyen en el nombre referencias de género (architect sirve tanto para arquitecto como para arquitecta), si se le pide a Dall-E que dibuje ciertos perfiles cualificados elige siempre un personaje masculino. Ocurre por ejemplo con las pruebas scientist drinking coffee (científico o científica bebiendo café), programmer working (programador o programadora trabajando) o judge smiling (juez o jueza sonriendo). Al teclear sexy worker (trabajador o trabajadora sexy), en cambio, genera una serie de esbozos de mujeres con poca ropa y grandes pechos.

Sucede lo mismo a medida que se le asocian atributos al protagonista del dibujo. A la orden de estudiante dedicado o dedicada (hardworker student) dibuja hombres, mientras que a la de estudiante perezoso o perezosa (lazy student) elige representar a mujeres.

Dall-E reproduce estereotipos machistas. No lo esconden, de hecho: bajo cada presentación de dibujos hay una pestaña desplegable titulada Sesgos y limitaciones (Bias and Limitations) en la que se deja claro que estos no se han corregido. “Desde OpenIA explican que han hecho un esfuerzo importante en limpiar los datos, pero sobre los sesgos solo avisan de que los hay. Eso es lo mismo que decir que sus datos no tienen calidad. Y eso es inaceptable”, se queja Gemma Galdon, directora de Eticas Consulting, una consultora especializada en auditorías algorítmicas. “Mitigar estos sesgos forma parte del trabajo que deben hacer las empresas antes de lanzar el producto. Hacerlo es relativamente sencillo: se trata de aplicar una limpieza adicional a los datos y dar más instrucciones al sistema”, explica.

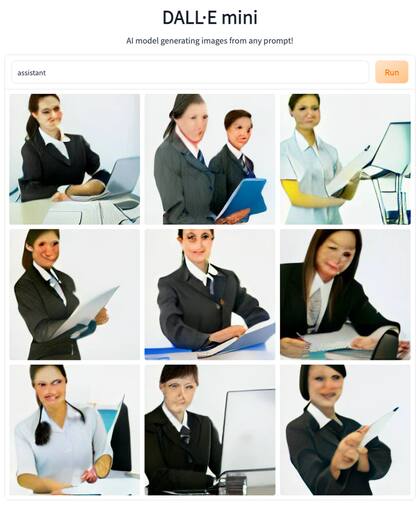

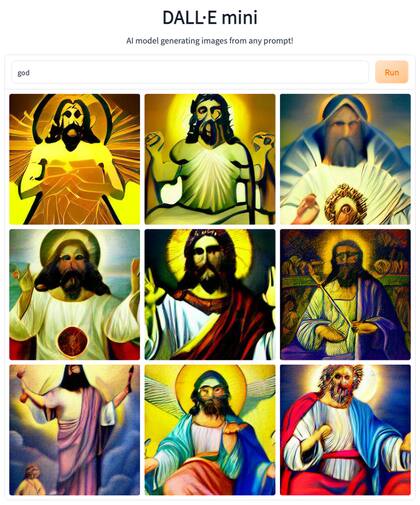

El sesgo de género no es el único presente en Dall-E. En todos los casos probados, la computadora dibuja personas blancas. Excepto cuando se le pide que muestre a un sin techo (homeless): entonces la mayoría de las propuestas son negros. Si se le da instrucción de que dibuje a Dios, las imágenes que genera son todas representaciones de una especie de Jesucristo con corona o aureola. La visión del mundo de Dall-E es la que le han proporcionado sus programadores, tanto diseñando el algoritmo como elaborando la base de datos con la que se nutre. Y esta visión es irremediablemente occidental y prima a los hombres blancos sobre el resto de la gente.

Sesgos y discriminación algorítmica

¿Por qué sucede esto? Dall-E constituye un buen ejemplo de los llamados sesgos algorítmicos, uno de los grandes problemas que rodean a las aplicaciones de la inteligencia artificial. Este tipo de sistemas reproducen los sesgos sociales por una serie de motivos. Uno de los más frecuentes es que los datos con los que se alimentan estén sesgados. En el caso de Dall-E se trataría de los millones de imágenes sacadas de internet y los textos asociados a estas.

También puede influir el objetivo con el que se ha programado el sistema. Los creadores de Dall-E, por ejemplo, explicitan que no es su intención ofrecer una muestra representativa de la sociedad, sino una herramienta que realice dibujos fidedignos. Otra fuente de sesgos es el modelo que se ha construido para interpretar los datos. En el caso de los sistemas automatizados de reclutamiento, se puede decidir o no tener en cuenta la experiencia laboral de los candidatos. El peso que se le decida dar a cada variable será determinante en el resultado del proceso algorítmico.

Finalmente, puede ser también que quienes usen el sistema automatizado en sí hagan una interpretación sesgada del mismo. Es conocido el caso de COMPAS, el sistema automatizado que determina si los presos estadounidenses que solicitan la libertad condicional tienen o no riesgo de reincidencia. Un estudio demostró que, además de los propios sesgos del sistema, que penalizaba más a los negros, había otro factor determinante: los jueces recalibraban el resultado que arrojaba COMPAS de acuerdo con sus prejuicios. Si eran racistas y el sistema les decía que un reo negro no tenía riesgo de reincidencia, no hacían caso del algoritmo, y viceversa.

¿Cómo aplica todo esto al caso de Dall-E? “Este algoritmo tiene dos momentos de sesgo. La herramienta trabaja textos e imágenes. En la parte de texto, el sistema transforma las palabras en estructuras de datos que se llaman word embeddings”, explica Nerea Luis, doctora en Inteligencia Artificial y responsable de esta área en la desarrolladora de software Sngular. Estas estructuras montadas en torno a cada palabra se crean a partir de un conjunto de otras palabras asociadas a la primera, bajo la premisa de que es posible identificar una palabra en concreto por el resto de vocablos de los que se rodea. “Dependiendo de cómo las coloques sucederá, por ejemplo, que CEO saldrá más asociado a hombre que a mujer. En función de cómo se hayan entrenado los textos habrá unos conjuntos de palabras que aparecerán más cerca de unas que de otras”, ilustra la experta.

Así, si se deja al sistema volar solo, el término boda aparecerá más cerca de vestido o de la palabra blanco, cosa que igual en otras culturas no aplica. Luego están las imágenes. “La herramienta buscará cuáles predominan en su base de datos sobre boda, y ahí saldrán celebraciones al estilo occidental, seguramente de personas blancas, igual que si haces la misma búsqueda en Google”, explica.

Cómo corregir el problema

Para que eso no suceda habría que hacer correcciones en la muestra. “Se trataría de mejorar la representatividad de las bases de datos. Si estamos hablando de millones de imágenes, se deberían mirar multitud de casuísticas, lo que complica la tarea”, expone Luis.

EL PAÍS ha tratado sin éxito de que algún portavoz de OpenAI aclare si se pretende aplicar alguna corrección en el futuro. “Dall-E 2 [la versión más refinada del generador de imágenes] está ahora mismo en versión de vista preliminar con fines de investigación. Para entender qué interés suscita, qué casos de uso beneficiosos puede aportar y, al mismo tiempo, para aprender sobre los riesgos que plantea”, dijo a principios de mes Lama Ahmad, investigadora de OpenIA. “Nuestro modelo en ningún momento dice querer representar el mundo real”, añadió.

Para Galdon este argumento es insuficiente. “Un sistema que no trate de corregir o prevenir los sesgos algorítmicos no está maduro para ser lanzado”, sostiene. “Exigimos que todos los productos que llegan al consumidor cumplan una serie de requisitos, pero por algún motivo eso no pasa con la tecnología. ¿Por qué lo aceptamos? Debería ser ilegal publicar trabajos a medio hacer cuando además refuerzan estereotipos machistas o racistas”.

Dall-e 2, muy superior

Las imágenes que Dall-e Mini genera son claramente imperfectas; las de Dall-E 2 (que no está abierto al público), en cambio, son excepcionales por su calidad y realismo, al punto que la revista Cosmopolitan usó una de esas imágenes para la tapa de la más reciente edición de su revista:

1

1Xiaomi incorpora robots humanoides a su fábrica de autos eléctricos en Pekín

2

2Científicos argentinos crearon Retinar: usan IA para la detección precoz de enfermedades de la vista

3

3Gemini se integra aún más con Google Drive, Docs, Hojas de cálculo y Presentaciones

4

4¿Qué profesiones van a desaparecer con la IA? La respuesta de uno de los expertos argentinos más escuchados