El futuro de los chips de computación: adiós al diseño pequeño, barato y más potente

Los límites físicos que enfrenta la evolución de los microprocesadores abre el debate en la industria y entre los especialistas para definir los próximos pasos a seguir más allá de la Ley de Moore

En la Conferencia Internacional de Circuitos Integrados, realizada en el campus de la Universidad de Pennsylvania en Philadelphia en 1960, un joven ingeniero informático llamado Douglas Engelbart presentó a la industria electrónica el concepto llamativamente simple pero innovador: el "scaling" o "redimensionamiento". El doctor Engelbart, que más tarde ayudó a desarrollar el mouse de computadora y otras tecnologías de computación personal, teorizó que a medida que los circuitos electrónicos se hicieran más pequeños, sus componentes se volverían más rápidos, requerirían menos energía y se harían más baratos de producir, todo a un ritmo acelerado.

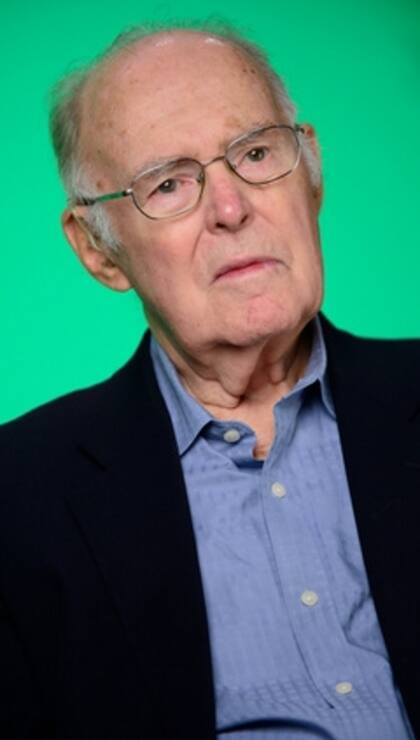

Ese día estaba en el público Gordon Moore, que luego ayudaría a fundar la Intel Corporation, el mayor fabricante de chips del mundo. En 1965, el doctor Moore cuantificó el principio del scaling y estableció algo que tuvo el impacto de una Carta Magna de la era informática. Predijo que el número de transistores que pueden incorporarse en un chip aumentaría al doble anualmente durante al menos una década, llevando a incrementos astronómicos en la capacidad de procesamiento. Su predicción apareció en la revista Electronics en abril de 1965 y luego se conoció como la Ley de Moore. No fue una ley de la física, más bien una observación acerca de la economía de una industria nueva que se mantuvo válida por medio siglo.

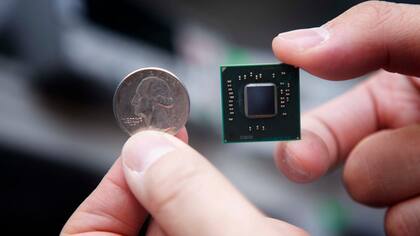

Un transistor, aproximadamente del diámetro de una fibra de algodón, costaba alrededor de 8 dólares de hoy a comienzos de la década de 1960. Intel fue fundada en 1968. Hoy miles de millones de transistores pueden apretujarse en un chip del tamaño de una uña y el costo de los transistores cayó a una fracción diminuta de un centavo.

Ese avance –la simple premisa de que los chips de computadora podrían hacer cada vez más y costarían cada vez menos- ayudó a Silicon Valley a llevar novedades impactantes al mundo, desde la computadora personal pasando por el teléfono inteligente hasta la vasta red de computadoras interconectas que dan vida a Internet.

Pero en los últimos años la aceleración predicha por la Ley de Moore no se ha sostenido. La velocidad de los chips dejó de incrementarse hace casi una década, el tiempo entre las nuevas generaciones se alarga y el costo de los transistores individuales se ha amesetado.

La ley de Moore no está muerta, pero va a haber que anotarla en la Asociación de Jubilados, dijo Henry Samueli, jefe de tecnología del fabricante de chips Broadcom

Los tecnólogos ahora creen que las nuevas generaciones de chips vendrán más lentamente. Quizás cada dos y medio a tres años. Y para mediados de la próxima década, temen, podría llegar el momento de la verdad, cuando las leyes de la física dicten que los transistores, para entonces compuestos de sólo un puñado de moléculas, no funcionen de modo confiable. Entonces la Ley de Moore llegará a su fin, a menos que se dé otra innovación tecnológica.

En términos antropomórficos, la Ley de Moore "está encaneciendo, está envejeciendo" dijo Henry Samueli, jefe de tecnología para Broadcom, fabricante de chips de comunicaciones. "La ley de Moore no está muerta, pero va a haber que anotarla en la Asociación de Jubilados".

En 1995 Moore revisó la tasa de aumento al doble, estableciendo que los intervalos serían de dos años. Aún así está impresionado por la longevidad de su pronóstico: "La predicción original fue que duraría 10 años, lo que me parecía bastante" dijo recientemente en un evento en san Francisco en el que se conmemoró el 50 aniversario de la Ley de Moore.

Pero la pregunta ominosa es qué sucederá si la combinación mágica de velocidades cada vez mayores, colapso de la demanda de electricidad y precios cada vez más bajo, no puede sostenerse.

El impacto se sentirá mucho más allá de la industria informática, dijo Robert P. Colwell, ex ingeniero eléctrico de Intel que ayudó dirigir el diseño del microprocesador Pentium cuando trabajó como arquitecto de computadoras para el fabricante de chips entre 1990 y 2000.

"Miren los automóviles, por ejemplo" dijo Colwell. "¿Qué es lo que ha dado impulso a sus innovaciones en los últimos 30 años? La Ley de Moore". La mayoría de las innovaciones de la industria automotriz en controladores del motor, frenos antibloqueo, navegación, entretenimiento y sistemas de seguridad provienen de semiconductores de costo cada vez menor.

La predicción original fue que duraría 10 años, lo que me parecía bastante, dijo Gordon Moore en un evento en san Francisco en el que se conmemoró el 50 aniversario de su enunciado

Estos temores van en el sentido opuesto a la narrativa central de un Silicon Valley eternamente joven. Durante más de tres décadas la industria ha sostenido que la computación se volverá más rápida, logrará mayor capacidad y tendrá costos menores a ritmo cada vez más acelerado. Se lo ha descripto como el "tiempo de Internet" e incluso la Singularidad, un punto en el que la capacidad informática supera la inteligencia humana, afirmación sostenida con convicción casi religiosa por muchos en Silicon Valley.

Cuando uno piensa en esas dimensiones, chocar con los límites de la física puede ser una experiencia de lo más humillante.

"Creo que la cuestión más fundamental es que hace mucho superamos el punto en la evolución de las computadoras en el que la gente dejó de comprar automáticamente el último y más poderoso chip informático con plena confianza de que sería mejor que el que ya tienen", dijo Colwell.

Los límites de la física

Los chips están hechos de cables metálicos y transistores con base en semiconductores, diminutos interruptores electrónicos que controlan el flujo de la electricidad. Los transistores y cables más avanzados son más pequeños que la longitud de onda de la luz, y los interruptores electrónicos más avanzados son más pequeños que un virus biológico.

Los chips se producen por medio de un proceso manufacturero llamado fotolitografía. Desde que se inventó a fines de la década de 1950, la fotolitografía evolucionó constantemente. Hoy se proyecta luz de láser ultravioleta a través de placas de vidrio recubiertas con una porción de un circuito expresado en una máscara de metal que se ve como un mapa de calles.

Cada mapa hace posible iluminar un patrón en la superficie del chip para depositar o eliminar metal y materiales semiconductores, dejando un sándwich ultra delgado de alambres, transistores y otros componentes.

Las máscaras se usan para reproducir cientos de copias exactas de cada chip, que luego son colocadas en obleas pulidas de silicio de un diámetro de alrededor de 30 centímetros.

Una máquina llamada "stepper", que actualmente cuesta alrededor de 50 millones de dólares cada una, mueve la máscara sobre la oblea exponiendo repetidamente cada patrón de circuito sobre la superficie de la oblea, alternadamente depositando y eliminando metal y componentes semiconductores.

Un chip de computadora acabado puede requerir hasta 50 pasos de exposición y la máscara debe estar alineada con precisión asombrosa. Cada paso plantea la posibilidad de errores infinitesimalmente pequeños.

"Yo he trabajado en muchas partes del proceso de los semiconductores" dijo Alan R. Stivers, físico cuya carrera en Intel comenzó en 1979 y que ayudó a introducir docenas de nuevas generaciones de semiconductores antes de jubilarse en 2007. "De lejos lo más difícil es la litografía".

Para construir dispositivos más pequeños que la longitud de onda de la luz, los fabricantes de chips han agregado una variedad de trucos como la litografía de "inmersión", que usa el agua para desviar mucho las ondas de luz y aumentar la resolución. También han usado una técnica llamada litografía "de patrón múltiple", que emplea pasos separados con las máscaras para aguzar los bordes y afinar aún más los alambres de metal y otros componentes de los chips.

Al reducirse el tamaño de los componentes y alambres a sólo un puñado de moléculas, los ingenieros han recurrido a simulaciones informáticas que requieren un poder computacional tremendo. "Uno le hace trampa a la física" dijo Walden c. Rhines, CEO de Mentor Graphics, una firma de software de automatización de diseño de Wilsonville, Oregon.

¿Si se acaba ese scaling descripto originalmente por Engelbart, cómo pueden evitar las compañías fabricantes de chips que se acabe también la Ley de Moore? Por empezar, podrían recurrir a nuevo software o nuevos diseños de chips que extraigan más poder de computación del mismo número de transistores.

Y hay esperanzas de que la misma creatividad que ha extendido la Ley de Moore tanto tiempo pueda hacer que siga avanzando la tecnología de los chips.

Si el silicio, en las palabras de David M. Brooks, un científico en ciencias de la computación de la Universidad de Harvard, es "la tela en la que pintamos", los ingenieros pueden hacer algo más que sólo reducir la tela.

El silicio podría ser reemplazado por materiales exóticos que permitan hacer transistores más rápidos y pequeños y nuevas formas de almacenado de memoria, así como vínculos ópticos en vez de electrónicos para las comunicaciones, dijo Alex Lidow, físico que es CEO de la Efficient Power Conversion Corporation, fabricante, de chips para propósitos especiales en El Segundo, California.

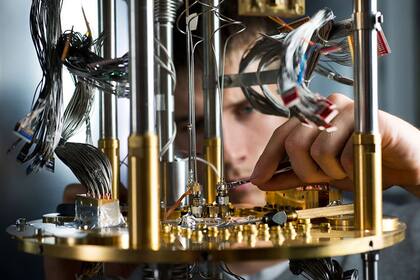

Hay una cantidad de candidatos a ser el recurso innovador, como la computación cuántica que –si se volviera práctica- podría acelerar enormemente el tiempo de procesado, y las llamadas Spintronics, que en el lejano futuro podrían ser la base de la computación en base a componentes de escala atómica.

Recientemente ha habido optimismo por una nueva técnica manufacturera, conocida como litografía ultravioleta extrema o EUV. Si funciona, la EUV, que provee ondas de luz que son aproximadamente de un décimo de la longitud de las ondas más cortas que componen el espectro visible, permitirán alambres y elementos aún más pequeños, simplificando al mismo tiempo el procedimiento para la fabricación del chip.

Pero aún no se ha probado la tecnología en producción comercial. Este año ASML, un fabricante de máquinas stepper holandés que es propiedad en parte de Intel, dijo que recibió un gran pedido de steppers EUV de un cliente de Estados Unidos. Sobre esta movida la mayoría de la gente en la industria cree que es Intel, que podría estar adelantado al resto de los fabricantes de chips.

Los ejecutivos de Intel, a diferencia de importantes competidores tales como Samsung y la Taiwan Semiconductor Manufacturing Company o TSMC, insiste en que la compañía podrá seguir haciendo chips cada vez más baratos por el futuro previsible. Y niegan la idea de que el precio de los transistores ha llegado a una meseta.

Sin embargo, mientras Intel sigue confiando en que puede continuar resistiendo la realidad cambiante del resto de la industria, no ha podido desafiar por completo la física. "Intel no sabe qué hacer respecto del fin inminente de la Ley de Moore" dijo Colwell.

En julio Intel dijo que retrasaría la introducción de la tecnología de 10 nanómetros (comparativamente, un pelo humano tiene un ancho de alrededor de 75.000 nanómetros) hasta 2017. La demora rompe con la tradición de la compañía de presentar una generación de chips con cables y transistores más pequeños un año, seguido del agregado de nuevos elementos de diseño el año siguiente.

"Las últimas dos transiciones de tecnología han indicado que nuestra cadencia está más cerca de dos años y medio que de dos años" dijo en una llamada colectiva con analista el CEO de Intel Brian Krzanich.

Se acabó el "Viaje Gratis"

La visión de vaso medio lleno de estos problemas es que la desaceleración del desarrollo de los chips llevará a más competencia y creatividad. Muchos fabricantes de semiconductores no cuentan con las fábricas de avanzada que ahora se están diseñando para cuatro fabricantes de chips: GlobalFoundries, Intel, Samsung y TSMC.

Las demoras podrían permitir a los fabricantes de chips que vienen a la zaga competir en un mercado que no requiere el desempeño más extremo, dijo David B. Yoffie, profesor de la Harvard Business School.

Y aunque el tamaño cada vez más reducido de los transistores no haga más rápidos y más baratos a los chips, si reducirá su requerimiento de electricidad.

Los chips de computación con consumo ultra reducido de energía que aparecerán al final de esta década en algunos casos ni siquiera requerirán batería, funcionarán con energía solar, vibración, ondas de radio o incluso sudor. Muchos de ellos serán nuevos tipos sofisticados de sensores, entretejidos de modo inalámbrico en sistemas de computación centralizados en la nube computacional.

¿A qué productos podrían llevar esos chips? Nadie lo sabe aún pero los diseñadores de productos se verán forzados a pensar de modo diferente lo que construyen, en vez de esperar a que los chips se hagan más poderosos. Gracias a la Ley de Moore las computadoras se han vuelto cada vez más pequeñas pero esencialmente se ha seguido el mismo concepto de chips, hardware y software en una caja cerrada.

"En el pasado los diseñadores fueron perezosos" dijo Tony Fadell, ingeniero eléctrico que encabezó el equipo que diseñó el iPod original y dirigió el diseño del hardware del iPhone antes de fundar Nest Labs, fabricante de dispositivos para hogares inteligentes como termóstatos y alarmas de humo.

Carver Mead el físico que acuñó el término Ley de Moore, está de acuerdo. "Básicamente tuvimos un viaje gratis", dijo. "Es realmente loco pero fue eso lo que aprovechamos".

Por cierto, la Ley de Moore podría estar vivita y coleando al menos otra década. Y si no, los seres humanos tendrán que volverse más creativos.

Traducción de Gabriel Zadunaisky

Otras noticias de Computadoras personales

1

1Renault Gordini modelo 2025: así sería el histórico vehículo, según la IA

2

2Histórico: China repavimentó casi 160 km de autopista con máquinas autónomas

3

3Se termina el Impuesto PAIS: cuánto costará un iPhone en el exterior desde diciembre 2024

4

4Las 5 señales que muestran que tenés una mentalidad positiva, según un análisis de IA