Según una encuesta mundial, Argentina está cuarta, junto a Brasil, como uno de los países donde más se usa esta herramienta de inteligencia artificial generativa

5 minutos de lectura'

5 minutos de lectura'

ChatGPT tiene, a la fecha, 200 millones de usuarios que acceden a la herramienta al menos una vez por mes, un número que duplica la cifra anunciada en noviembre último, según le dijo un vocero de la compañía a Axios. La herramienta de inteligencia artificial generativa debutó en octubre de 2022, y desde entonces ha logrado mantenerse como líder centro del segmento, al menos desde lo conceptual, mientras surgen competidores (sobre todo, Gemini, de Google; Meta AI, de Meta; y las renovadas Siri y Alexa, cuando estén disponibles en los próximos meses, pero también Claude y otros motores similares).

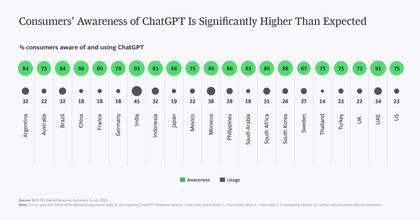

Pero el dato inusual lo aporta el Boston Consulting Group, que hace poco publicó los resultados de una encuesta hecha a fines de 2023 alrededor del mundo, y encontró que la mayor penetración de ChatGPT (es decir, qué porcentaje de la población conoce o usa con frecuencia esta herramienta) está en India, donde el 93% de los encuestados había oído nombrar la herramienta, y un 45% la había usado al menos una vez; la siguen Marruecos, Emiratos Árabes y, en un empate técnico, Argentina y Brasil, ambos países con los mismos números: el 84% de los encuestados escuchó hablar de ChatGPT, el 32 por ciento lo usó al menos una vez.

Mientras tanto OpenAI, la startup que está detrás de ChatGPT, está en conversaciones para recaudar miles de millones de dólares en una nueva ronda de inversión que podría valorar a la compañía en más de 100.000 millones de dólares, según informó el Wall Street Journal, que consignó que además de Microsoft (principal inversor hasta ahora en la compañía) y el fondo de inversión Thrive Capital, compañías como Apple e Nvidia también podrían ser parte de quienes aporten capital.

La compañía tuvo, además, una semana agitada: el martes compareció ante un tribunal federal de California para responder a las acusaciones de uso indebido de la obra de autores como Michael Chabon, Ta-Nehisi Coates y la comediante Sarah Silverman para entrenar su modelo lingüístico de inteligencia artificial.

En su respuesta a las denuncias, la empresa afirmó que hace un uso justo de contenidos protegidos por derechos de autor para enseñar a modelos. “Los modelos aprenden, como hacemos todos, de lo que ha venido antes”, dijo OpenAI en su presentación. “La defensa del uso justo existe precisamente por esa razón: para fomentar y permitir el desarrollo de nuevas ideas que se basan en otras anteriores”.

Tanto Meta (que también ha sido demandada) como OpenAI han convencido a los jueces para que desestimen algunas de las demandas, pero los tribunales aún no han abordado la cuestión central de si el uso de material extraído de Internet para entrenar la IA infringe los derechos de autor a gran escala. El uso legítimo promueve la libertad de expresión al permitir el uso de obras protegidas por derechos de autor sin autorización previa en determinadas circunstancias. Los tribunales suelen centrarse en si un uso es transformador para determinar si es justo.

Esta semana también llegó a un acuerdo con el gobierno estadounidense, al que dará acceso a sus nuevos modelos de lenguaje previo a lanzarlos para identificar posibles riesgos. Los modelos de lenguaje son programas que permiten generar, según el caso, texto, imágenes o sonido a partir de una instrucción en lenguaje corriente, como el propio ChatGPT. El AI Safety Institute (Instituto de Seguridad para la Inteligencia Artificial), creado en 2023 por el gobierno de Joe Biden, concluyó un acuerdo similar con un competidor de OpenAI, Anthropic, según un comunicado publicado el jueves.

Las dos start-ups se comprometieron a colaborar con el instituto para “evaluar las capacidades (de los modelos) y los riesgos de seguridad” que puedan plantear, así como a trabajar en “métodos para gestionar estos riesgos”, indicó el organismo.

OpenAI también hizo público su apoyo a un proyecto de ley estadounidense que obligaría a agregar una “marca de agua” digital a un contenido generado en forma sintética (sea texto, audio, imagen, video, etcétera) para que pueda ser identificado rápidamente como tal. Con países que representan un tercio de la población mundial celebrando elecciones este año, los expertos están preocupados por el papel que desempeñarán los contenidos generados por IA, que ya han tenido un rol destacado en algunas elecciones, como en Indonesia. “Las nuevas tecnologías y normas pueden ayudar a la gente a entender el origen de los contenidos que encuentran en línea, y evitar la confusión entre los contenidos generados por humanos y los generados por una IA fotorrealista”, escribió Jason Kwon, director de estrategia de OpenAI.

Con información de AFP y Reuters

1

1Xiaomi incorpora robots humanoides a su fábrica de autos eléctricos en Pekín

2

2Científicos argentinos crearon Retinar: usan IA para la detección precoz de enfermedades de la vista

3

3Gemini se integra aún más con Google Drive, Docs, Hojas de cálculo y Presentaciones

4

4¿Qué profesiones van a desaparecer con la IA? La respuesta de uno de los expertos argentinos más escuchados