Una regulación para la inteligencia artificial

Las redes sociales nacieron, en particular, con la aparición de Facebook en 2004. Otros intentos de negocio similar existieron en varias partes del mundo, como en la Argentina, con redes como Sónico (que no prosperó) y la denominada Facepopular, una red social “nacional y popular” que sobrevivió unos días. Al poco tiempo de su nacimiento, la red social fundada por Mark Zuckerberg adquirió Instagram, por la módica suma de 1000 millones de dólares (hoy su valor supera ese importe en miles de millones), consolidando la “vidriera virtual” que nos gobierna en la actualidad, donde la consigna es aparentar lo que no se es, en un constante estado de bienestar. Vidrieras eran las de antes.

Miles de personas comparten a diario contenido que ilustra felices imágenes familiares, microtrajes de baño para mujeres y hombres con alguna cerveza en la mano, comidas opíparas, viajes sofisticados y otro sinfín de variedades de consumo y escasez humana que alimentan el ego, la baja autoestima y la necesidad de ser vistos, de la mano de la frase popular que afirma: “Lo que no se instagramea no existe”, dando a la red social el poder de definir el bienestar, el humor y la mismísima humanidad del ser humano: triste, pero tangible.

La verdad es que la realidad se encuentra fuera de la pantalla del celular, aunque las redes sociales, que con fauces de león hambriento siguen monetizando contenido ajeno con publicidad dirigida, continúan colaborando con el desarrollo de una “generación IG” donde impera la ficción, la dopamina del “likeo” y la cultura de la comparación: es penoso que la salud mental de un ser humano sea definida por la “calculadora del like”.

Todo este desmadre ocurrió en 20 años y aunque lo hemos advertido, muchas veces predicando en el desierto, ya es tarde para darle vuelta al embrollo: solo nos queda seguir educando y concientizando en un uso responsable de las redes. Sabe Dios cuáles son y serán los daños psicológicos y emocionales que se han causado y se siguen generando en chicos y grandes que no despegan su mano del celular.

Frente a este fenómeno cultural, algunos países salieron a ponerles el pecho a las balas, como en la Unión Europea, mientras otros siguen durmiendo una siesta interminable, como el nuestro, donde todavía no existe una ley especial aplicable a buscadores de internet y redes sociales, no obstante los distintos proyectos de ley que se han presentado y que han quedado en el olvido (es ingenuo pensar que si no se actualiza la ley de alquileres, que impacta sobre millones de argentinos, alguien se va a preocupar por estos temas, generando una idea que termine en ley).

No solo carecemos de una ley especial aplicable a estos jugadores, sino que seguimos manteniendo leyes antiguas en temas vinculados, como nuestra ley de protección de datos personales del año 2000, que ha quedado vetusta en relación con otras legislaciones avanzadas como el Reglamento General de Protección de Datos de la Unión Europea o la ley de privacidad del estado de California. Si bien en 2022 la Agencia de Acceso a la Información Pública confeccionó un proyecto de ley de protección de datos conforme los estándares internacionales, todo quedó en la nada, una vez más.

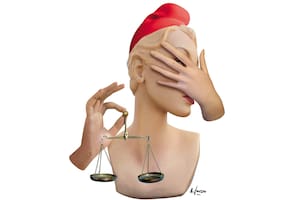

En conclusión, la batalla de las redes sociales y la fijación de reglas claras para su actuación resulta tardía, a la luz de los resultados de la “megaadicción” consolidada a nivel cultura. La batalla que aún no está perdida, que requiere ocuparse con urgencia y seriedad, es la de la regulación de la inteligencia artificial, devenida la cuarta generación de internet (web 4.0).

Recordemos que la inteligencia artificial (IA) es la disciplina científica que se ocupa de crear programas informáticos que ejecutan operaciones comparables con las que realiza la mente humana. Se nutre de técnicas de “minería de datos, machine learning y deep learning”, que permiten definir patrones de conducta y la toma de decisiones. Se integra con algoritmos con capacidad de aprendizaje automático, esto es, la capacidad de aprender por sí mismos de la información a la que acceden, de manera que pueden considerar experiencias propias pasadas para generar una nueva respuesta adaptada a una misma situación.

Estos conceptos han tenido particular explosión recientemente con la aparición del ChatGPT4 y con el desarrollo de la tecnología deepfake. Tal como se desprende del artículo de opinión de Yuval Harari publicado recientemente por The New York Times, el GhatGPT4 tiende a apoderarse de la palabra, con la facultad de definir cultura y opinión, y la segunda de las tecnologías mencionadas, alimentada por IA, permite confeccionar supuestos videos, aparentemente reales, de supuestas personas que nunca participaron de esos videos y que nunca dijeron lo que supuestamente los mismos refieren.

Supongamos que el día de mañana un abuelo recibe vía WhatsApp un supuesto video de su supuesto nieto requiriendo un rescate de 10.000 dólares por un supuesto secuestro que nunca existió: ¿podemos pensar que el abuelo, que poco conoce de la tecnología deepfake de IA, va a dudar un minuto en pagar? Seguramente no dudará y pagará. Todas estas situaciones, que vemos en la práctica profesional y que también impactan en la política, el periodismo y en el universo de las relaciones interpersonales, nos obligan a tomar conciencia de la necesidad de establecer reglas de juego claras para esta industria que, por cierto, no para, aunque Elon Musk, junto con otros académicos y empresarios, haya requerido públicamente poner freno, por unos meses, a su desarrollo. Seguramente nadie frenó, sino que pisaron el acelerador.

Nadie pretende que se paralice el desarrollo de una tecnología que puede beneficiar, en miles de aspectos, a muchas personas, en distintos ámbitos de la vida, como la salud; lo que se propone es que se establezca una regulación seria y responsable que ponga límites a su uso indebido y descontrolado para que, quienes desarrollan la actividad, practiquen un comportamiento ético y ajustado a derecho, que respete las libertades individuales, las garantías constitucionales y la autonomía de las personas. Porque si no atendemos estas cuestiones vamos a llegar tarde otra vez, y de esta sí que no hay retorno.

Abogado y consultor especialista en Derecho Digital, Privacidad y Datos Personales; director del Programa de Derecho al Olvido Digital de la Universidad Austral. Profesor Facultad de Derecho UBA