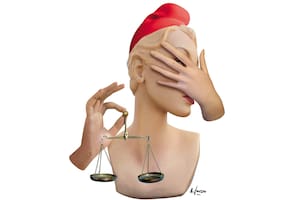

Nota mental. La inteligencia artificial tiene un problema de imagen

No es un robot con rasgos humanos el que está tomando decisiones por vos: hay una brecha entre cómo la ilustramos y la manera en la que funciona

5 minutos de lectura'

5 minutos de lectura'

Si esta semana usaron un corrector de textos automático, del otro lado de la pantalla no había un robot con forma humana tipeando en un teclado. Si Instagram les recomendó la cuenta de una marca de ropa que les gustó, no fue a través de un cerebro con conexiones azules encendidas. Y si una aplicación en sus teléfonos les indicó la mejor manera de llegar a un lugar, esa información no vino de un call center lleno de robots analizando datos del tránsito en tiempo real. A pesar de esto, las imágenes que normalmente se usan para ilustrar contenidos vinculados a la Inteligencia Artificial están repletas de robots con caras humanas, pensativas y hermosas como estatuas griegas, cerebros formados por tramas de circuitos electrónicos y luces azules futuristas.

La inteligencia artificial tiene un problema de imágenes: todavía no sabemos cómo ilustrarla, porque hay una brecha entre el imaginario que tenemos de ella y su manera concreta de funcionar. Desde el proyecto Better Images for AI (Mejores imágenes para la IA), que busca crear un repositorio abierto de imágenes sobre IA diferente a ese estereotipo futurista, lo explican así: “El predominio de imágenes antropomórficas e inspiradas en la ciencia ficción, y la falta de imágenes o ideas alternativas fácilmente accesibles, dificultan la comunicación precisa sobre la IA. Esto es importante porque sin una comprensión pública más amplia de las tecnologías, las aplicaciones y la gobernanza de la IA, muchas personas no conocen los cambios importantes que afectan sus vida”.

La inteligencia artificial tiene un problema de imágenes: todavía no sabemos cómo ilustrarla, porque hay una brecha entre el imaginario que tenemos de ella y su manera concreta de funcionar.

De acuerdo a ese argumento, necesitamos que la información acerca de cómo este tipo de tecnologías son producidas y funcionan sea más accesible y fácil de comprender. Todo está pasando ahora mismo –la velocidad de adopción de ChatGPT durante el último mes es un ejemplo de la explosión de noticias y desarrollos que vamos a ver durante los próximos años–, y por eso también es ahora mismo el momento en el que podemos evitar que la inteligencia artificial se convierta en una caja oscura sobre la que muy pocos tienen influencia.

Algunas de las soluciones que Better images for AI propone para ilustrar historias sobre inteligencia artificial apuntan a hacer más visible su proceso de producción. En una de las imágenes que integran su repositorio, se puede ver a dos personas que señalan un monitor y deliberan acerca de algo. El título de la foto es “analistas discutiendo el etiquetado correcto de un conjunto de datos”. Aunque es más aburrida que un robot futurista, esa imagen representa un aspecto importante de la inteligencia artificial: en su producción hay seres humanos tomando decisiones, y esas decisiones tienen impacto. Los seres humanos –y los datos que producimos a través de nuestras interacciones diarias con la tecnología– tienen sesgos, que se trasladan a las bases de datos que se usan para entrenar algoritmos. Y muchas veces esos algoritmos arrojan resultados sesgados en términos de variables como el género y la raza.

La distancia entre el imaginario colectivo sobre la tecnología y el desarrollo real de esas tecnologías solía estar mediada por el tiempo. Los relatos de Crónicas marcianas, de Ray Bradbury, suceden en el 2000 pero fueron publicados en 1950. Los autos voladores de los Supersónicos fueron imaginados en 1962. Y Isaac Asimov escribió las tres leyes de la robótica en 1942: “1) Un robot no puede dañar a un ser humano o, por inacción, permitir que un ser humano sufra daños; 2) un robot debe obedecer las órdenes que le den los seres humanos, excepto cuando tales órdenes entren en conflicto con la Primera Ley; 3) un robot debe proteger su propia existencia siempre que dicha protección no entre en conflicto con la Primera o Segunda Ley”.

Estos principios regían el comportamiento de robots humanizados mucho más parecidos a las ilustraciones que usamos hoy para ilustrar contenidos sobre inteligencia artificial que a los usos actuales de ese tipo de tecnología. El imaginario de la ciencia ficción, también estuvo mediado por las ideas sociales del momento en el que se escribía. Muchas veces reflejaban el optimismo por el futuro –Julio Verne y la confianza en el progreso en el siglo XIX–, y muchas otras el temor –Odisea en el espacio (1968) durante la Guerra Fría–.

Hoy la inteligencia artificial avanza tan rápido que desaparece el tiempo como mediador, pero las ideas sí están y vale la pena preguntarse cuáles son. Achicar la brecha entre imaginario y desarrollo tecnológico real nos va a ayudar a hacernos las preguntas correctas. Nos puede ayudar a pensar, por ejemplo, menos en si sueñan los androides con ovejas eléctricas y más en estrategias para mejorar el impacto de la adopción de inteligencia artificial.

Periodista y colaboradora en Sociopúblico