El futuro de los datos personales recolectados por gobiernos y empresas

1 minuto de lectura'

1 minuto de lectura'

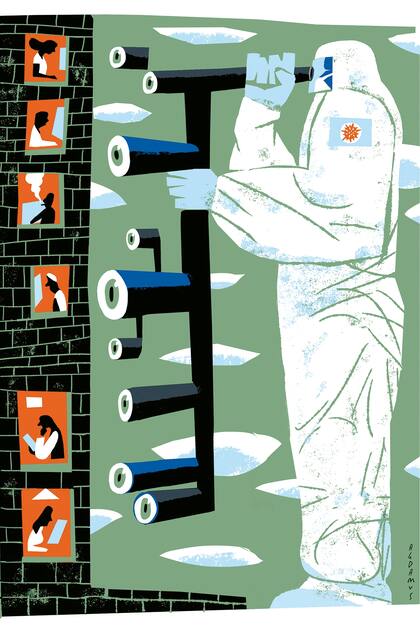

Si hace dos años el escándalo de Cambridge Analytica (por el cual se recopilaron y usaron sin consentimiento datos de 50 millones de usuarios) conmocionaba a la opinión pública y ponía el foco sobre el creciente poder de corporaciones como Facebook –la historia trascendió aún más por el documental Nada es privado–, hoy el estado de situación tiene a especialistas y usuarios en vilo. Mientras que algunos gobiernos se encuentran a la vanguardia de la lucha contra el Covid-19 a fuerza de un control digital estricto sobre sus ciudadanos, con la llegada y utilización masiva de servicios de videoconferencia y otras apps, se expandieron preocupaciones en torno al uso de nuestros datos personales.

El panorama en términos de privacidad y Big-Data también muestra evidentes cambios en el escenario geopolítico. En ese sentido, ¿por qué es tan importante seguir de cerca tanto a los Estados como las grandes corporaciones? Nuevos escenarios, amenazas y desafíos, pensando en el mundo después de la pandemia.

Ya hace varias semanas que prestigiosas publicaciones internacionales comenzaron a advertir sobre los gaps de seguridad que presentaba la hoy célebre aplicación de videollamadas Zoom, cuyo uso diario creció un 535% desde que comenzó el aislamiento obligatorio en la mayoría de los país. Desde reportes que incluían advertencias sobre que la misma permitía que el administrador de la sesión vea si un usuario clickeaba fuera de la ventana –es decir, prestaba atención a otra cosa–, a denuncias más graves como el filtrado de información personal y la posibilidad de que extraños puedan sumarse a las videollamadas (sean públicas o privadas), un problema vinculado con la sospecha de que el servicio no incluye un sistema cifrado de extremo a extremo (que solo los usuarios que se comunican puedan leer los mensajes).

Así, la modalidad de zoombombing copó los titulares con algunos sucesos simpáticos y otros mucho menos inocentes en donde hackers irrumpieron en sesiones de videollamadas para publicar imágenes obscenas o hacer comentarios racistas. Incluso, desde el Washington Post ya se rotulaba a esta modalidad como otro tipo de acoso online. Sin embargo, lo que sucedió con el Zoom no es nuevo y tiene que ver con una mentalidad de desarrollo y creación de valor digital porterior al tech-boom del 2000, donde el objetivo ha sido crear empresas o servicios de manera rápida sin detenerse en cuestiones fundamentales como la seguridad. O como proclamaba el lema de Facebook: "Moverse rápido y romper cosas" (Move fast and break things). "Esto dio paso a una manera de trabajar, de crear servicios y a un modelo de negocios basado en la recolección de datos personales. En el caso de Zoom, podemos decir que se falla en algo que se llama privacidad por diseño, que es un principio que hay para la protección de la privacidad y de los datos personales en el diseño de la tecnología. Solo se tiene en mente hacer una app; también lo podemos relacionar con esta fiebre para armar apps sobre todo ahora en cuarentena", advierte Javier Pallero, activista digital y coordinador global de moderación de contenidos de Access Now.

Marina Benítez Demtschenko, abogada en Derecho Informático, ciberfeminista y fundadora de FemHack Argentina, se muestra menos sorprendida. "El zoom affaire es más de lo mismo, pero la comunidad digital se sigue sorprendiendo: esto tiene que llamarnos la atención por sí solo. Que usuarios sigan sorprendiéndose da cuenta de la poca información que hay, de la alfabetización digital que les hace falta. Porque alfabetización digital no es solo saber prender la computadora o usar una aplicación; es conocer las implicancias de nuestro carácter de productores de contenido online, como proveedores de información privada y personal las 24 horas del día. Los derechos digitales que suponen derechos personalísimos –como lo son la intimidad digital, la privacidad digital, la autodeterminación informativa, la libertad de expresión digital, la identidad digital–, están más vulnerables en estos tiempos. Ejercer derechos digitales no es solamente saber de los riesgos. También implica reconocerse titulares de ellos y saber cómo defenderse ante ataques".

En este sentido, resulta imposible pedirle al usuario promedio que se convierta en un auditor de seguridad de cada app que se baja y usa. Para intentarlo, al menos, una idea que debería grabarse a fuego es que una vez que se pierde la privacidad, es muy difícil recuperarla.

Vigilancia y grandes corporaciones

Ya lo decía el filósofo surcoreano Byung-Chul Han a comienzos de abril último, cuando advertía que la ventaja en afrontar el virus de los países asiáticos por sobre los europeos residía tanto en factores culturales (obediencia y confianza en los gobiernos) como tecnológicos (vigilancia digital y uso de Big Data). En particular, esto último parece posicionar a Japón, Corea, Taiwán y China a la cabeza de la lucha contra el coronavirus. El estricto régimen de control de sus ciudadanos de este último país incluye más de 200 millones de cámaras con reconocimiento facial, en un contexto donde se vigila cada clic, cada movimiento en redes sociales y cada consumo. Consideraciones sobre la utilización, pero también sobre la efectividad de estas herramientas para diagnosticar y realizar seguimiento en pandemia deben ser tenidas en cuenta, en especial, cuando podrían usarse no solo como un medio de vigilancia y control social, sino también aislando (y estigmatizando) a enfermos cuando se levante la cuarentena.

Un rápido paneo muestra a China desplegando drones y los consabidos CCTV, mientras que en sitios como Singapur o Israel se emplea una combinación de información de geolocación, video e información de compras con tarjeta de crédito para seguir de cerca la evolución del Covid-19 en sus países. Hay casos más extremos, como en Hong Kong, donde les han hecho a los cuidadanos usar pulseras vinculadas a apps que pueden alertar a las autoridades si una persona dejó su lugar de cuarentena. En la India, el gobierno avanzó con medidas como el sellado en las manos de todos los que ingresaban al país, y recursos como información de las aerolíneas y trenes combinados con registros de llamadas, vigilancia por cámara y tracking vía teléfonos inteligentes.

"Durante emergencias nacionales, el delicado balance entre seguridad pública y privacidad personal tiende siempre a inclinarse hacia la vigilancia gubernamental, pero se requieren límites sobre la recolección de data y su uso, y sobre todo una evaluación independiente", explica la periodista especializada en tecnología de The New York Times Shira Ovide, quien en las últimas semanas abrió un debate con distintos expertos desde su newsletter a raíz de la alerta despertada y la divisoria de aguas en torno a algunas de estas medidas tomadas en EE.UU.

Pero no solo los Estados parecen estar en una carrera por desarrollar métodos más efectivos de control digital (que a su vez deberán analizar cómo volverlos atrás una vez superada la pandemia). La noticia de que dos gigantes como Google y Apple también estaban por hacer una alianza para colaborar en el control de la curva de infectados, despertó todo tipo de especulaciones y preguntas. "Necesitamos mantenernos abastecidos, conectados e informados, ¿pero les estamos dando demasiado poder a estas compañías de tecnología ahora, posiblemente para siempre?", se preguntaba Ovide. La iniciativa de hacer tracking de los ciudadanos y así avisarles por ejemplo a quiénes estuvieron expuestos al virus no es nueva; sucede que su grado de eficacia disminuye cuando se les solicita a las personas que bajen, volutariamente, determinadas aplicaciones. Por eso, Google y Apple han ofrecido colaboración con los gobiernos para que las mismas sean instaladas con las actualizaciones de software en los distintos sistemas operativos. Una medida compulsiva y en la que el usuario no tendría mucha capacidad de decisión.

En paralelo, distintos actores de la sociedad civil, como universidades u organizaciones, también intentan aportar su granito de arena (y control, aunque menos discutidos por ahora) en esta crisis. Mediante dispositivos como smart-watches, desde la Universidad de Standford vienen testeando un programa piloto que les permitiría predecir enfermedades (también el Covid), para lo cual están pidiendo la colaboración de usuarios de todas las marcas de relojes (Fitbit, Apple Watch, Amazfit, etcétera). Lo mismo hacen investigadores de la Universidad de San Francisco, que además les están dando anillos Oura (anillos que miden distintas variables biológicas) a los trabajadores de la salud para estudiar patrones. La idea es poder desarrollar un algoritmo que, en base a las muestras tomadas, detecte patrones inusuales en el cuerpo (cambios en el ritmo cardíaco, temperatura y otras características que hacen a la respuesta inflamatoria del cuerpo) y alerte a los usuarios. Más allá de la viabilidad de esta misión, teniendo en cuenta la rapidez del contagio, la variedad de síntomas y la prevalencia de huéspedes asintomáticos, y aun cuando se trata de estudios con voluntarios, también surgen preguntas respecto de los usos futuros de esta información, la relación con las corporaciones que venden estos dispositivos y el monopolio de datos.

La teoría dicta que si las aplicaciones y empresas están obligadas por la ley, y las leyes de protección de datos personales están actualizadas y se cumplen, tiene que haber al menos un nivel de seguridad alto. Sin embargo, de la teoría a la práctica puede haber un largo trecho, y aún así el más alto de los niveles de seguridad puede fallar porque no existe la seguridad informática perfecta, según explica Pallero. "No existe lo inhackeable; teniendo en cuenta eso, no hay que tener miedo, hay que vivir tranquilo, hay que hacer todas las actividades que queramos en línea, pero tratando de utilizar servicios de renombre que estén bien diseñados, exigirle al Estado que haya leyes de protección de datos y que las autoridades de aplicación tengan a las empresas cortitas y las obliguen a cumplir".

En la Argentina, la Ley de Protección de Datos está desactualizada. "El reglamento europeo de protección de datos personales trae protecciones para que te expliquen las decisiones tomadas mediante el uso de mecanismos automatizados, y también que vos tengas el derecho a optar para que no se usen (por ejemplo, al solicitar un crédito). También, derecho a pedir explicación de los procesos de automatización". Justamente, existen discrepancias en la ley en lo que refiere al uso masivo de datos y su anonimización. La ley es del 2000 y ya solo el tema de las multas que se le aplican a las empresas ha quedado demodé. En lo relativo al enforcement, es decir, la aplicación efectiva de las leyes de protección de datos, para pasar de la teoría a la práctica, se requieren tanto organismos independientes que analicen y apliquen multas a quienes no lo hacen, como incentivos y políticas públicas para premiar y fomentar las buenas prácticas (educación digital en las escuelas, beneficios para empresas, etcétera).

Por otro lado, la perspectiva de género en el ámbito del derecho digital ha planteado numerosos desafíos, ya que las mujeres partimos con el tablero desbalanceado, también en este sentido. "Las mujeres no tenemos la misma experiencia tecnodigital que los varones, acá también se ve la brecha digital de género, y ello obliga a que todo lo relacionado con tecnologías de la información y la comunicación y la era digital tengan visión de género, para evitar errores garrafales como la generalización de los efectos", dispara Demtschenko.

Un tópico que afecta especialmente a mujeres y se pone de relieve en tiempos de pandemia con el encierro y cierto tipo de dinámicas sociales que se dan, es el caso de la difusión no consentida de material íntimo o de acoso virtual, mal llamado revenge porn. "Desde 2012 vengo promoviendo el destierro de ese término para hacer alusión a la difusión no consentida de material íntimo, ya que tiene la frase un sesgo sexista muy fuerte. Considerar que generar contenido erótico o sexual en el marco de la intimidad es producir pornografía es errado. El material íntimo audiográfico, visual, textual o verbal, solo se realiza con el sentido de la autoestimulación erótica o el intercambio consentido con otra persona que también acuerda recibirlo. La difusión por fuera de los límites de la privacidad es una conducta dañosa".

Estas conductas tampoco no son considerados delitos en la Argentina, donde el 90% de las víctimas son mujeres, haciendo que las usuarias estemos mucho más expuestas a la violencia digital machista. Algo que se ve intensificado por el tiempo disponible que los agresores han tenido en esta cuarentena para estar conectados.

Aún sin un horizonte claro respecto de cómo será volver a la normalidad, resta preguntarnos por el poder que –conscientemente o no– se les está dando a Estados y grandes corporaciones en este nuevo escenario. Del mismo modo, resta ver cómo la ley puede ponerse al corriente con los nuevos usos y complejidades emergentes desatadas por esta crisis de salud, así como si existen alternativas más respetuosas para el monitoreo de la enfermedad y el seguimiento de pacientes. Y cuánto de esto debería ser desarrollado por empresas privadas, observando con más atención nuestras interacciones online, informándonos y siendo conscientes de la dimensión de nuestra privacidad. Eso al menos ya parece un comienzo.

1

1Laura Romano, nutricionista especialista en dietas: “Ni las medialunas engordan ni las tostadas light adelgazan”

2

2“¿Qué hago con esto que me tocó vivir?”: le diagnosticaron esclerosis múltiple y decidió cambiar su vida para ayudar a otros

3

3Efemérides del 12 de marzo: ¿qué pasó un día como hoy?

4

4En fotos. Una comida chic en Pasaje del Correo, arte en la casa de Victoria Ocampo y una muestra de fotos en Recoleta