Tras la publicación de una entrevista, el “padrino” de la Inteligencia Artificial aclaró que Google había “actuado de forma muy responsable” y negó que hubiera dimitido para poder criticar a su antiguo empleador

3 minutos de lectura'

3 minutos de lectura'

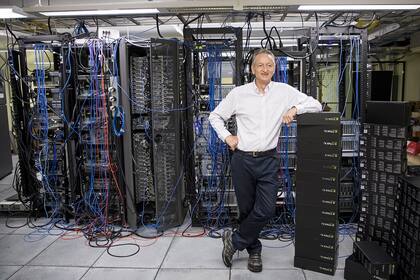

NUEVA YORK.- Geoffrey Hinton, un pionero de la inteligencia artificial, aclaró que dejó Google para hablar libremente sobre los peligros de esta revolucionaria tecnología, después de darse cuenta de que las computadoras podrían llegar a ser más inteligentes que las personas mucho antes de lo que él y otros expertos esperaban, tras una entrevista con The New York Times que despertó temores sobre la IA.

“Me fui para poder hablar de los peligros de la IA sin considerar cómo afecta esto a Google”, escribió Geoffrey Hinton en Twitter.

In the NYT today, Cade Metz implies that I left Google so that I could criticize Google. Actually, I left so that I could talk about the dangers of AI without considering how this impacts Google. Google has acted very responsibly.

— Geoffrey Hinton (@geoffreyhinton) May 1, 2023

En una entrevista con elThe New York Times, Hinton dijo que le preocupaba la capacidad de la IA para crear imágenes y textos falsos convincentes, creando un mundo en el que la gente “ya no será capaz de saber lo que es verdad”.

“Es difícil ver cómo se puede evitar que los malos actores la utilicen para cosas malas”, afirmó.

La tecnología podría desplazar rápidamente a los trabajadores y convertirse en un peligro mayor a medida que aprende nuevos comportamientos.

“La idea de que estas cosas puedan llegar a ser más inteligentes que las personas es algo que algunos creían”, declaró al New York Times. “Pero la mayoría de la gente pensaba que estaba muy lejos de la realidad. Y yo también. Pensaba que faltaban de 30 a 50 años o incluso más. Obviamente, ya no pienso eso”.

En su tuit, Hinton dijo que la propia Google había “actuado de forma muy responsable” y negó que hubiera dimitido para poder criticar a su antiguo empleador.

The Times citó al jefe científico de Google, Jeff Dean, en un comunicado: “Seguimos comprometidos con un enfoque responsable de la Inteligencia Artificial. Aprendemos continuamente para comprender los riesgos emergentes al tiempo que innovamos con audacia”.

Desde que la startup OpenAI, respaldada por Microsoft, lanzó ChatGPT en noviembre, el creciente número de aplicaciones de “IA generativa” que pueden crear texto o imágenes ha provocado preocupación sobre la futura regulación de la tecnología.

“El hecho de que tantos expertos manifiesten su preocupación por la seguridad de la IA, y que algunos informáticos lleguen incluso a arrepentirse de algunos de sus trabajos, debería alarmar a los responsables políticos”, afirma Carissa Veliz, profesora asociada de Filosofía en el Instituto de Ética de la IA de la Universidad de Oxford. “Ha llegado el momento de regular la IA”.

Agencia Reuters

1

1Quién es René Redzepi, el chef danés acusado de malos tratos a su personal

- 2

El influyente pensador europeo Jacques Attali advierte sobre como podría desencadenarse una tercera guerra mundial

3

3Día 14 de la guerra entre Estados Unidos, Israel e Irán: todo lo que hay que saber

- 4

La ofensiva de Israel exacerba las tensiones internas en el Líbano y sobrevuela la amenaza de otra guerra civil