El ciclón tropical Imelda no fue el más intenso de 2019, pero sus efectos en algunos barrios de Houston, Texas, fueron catastróficos, con inundaciones y pérdidas multimillonarias. El 19 de septiembre pasado, cuando los equipos de rescate recién empezaban a trabajar, un grupo de científicos de datos emitió un rápido comunicado que en los días siguientes se convirtió en la explicación más citada por los medios para entender el fenómeno: por culpa del cambio climático, la tormenta severa tuvo 2,6 veces más probabilidades de ocurrir y fue un 28% más intensa que en un mundo simulado sin crisis climática.

El grupo "World Weather Atribution" logró este cálculo gracias a avances recientes de la ciencia de datos, que permitieron separar otros factores explicativos para lograr una estimación más precisa, que además permite, a futuro, pronosticar mejor los riesgos de la agenda medioambiental.

Para el MIT, la "atribución al cambio climático" es una de las diez principales tendencias de avances a monitorear en 2020, porque puede dar vuelta la opinión pública (sobre todo en los Estados Unidos) y generar otros incentivos políticos una vez que pase la crisis del coronavirus. Para el campo de la inteligencia artificial, la discriminación de causalidad es una de las batallas del momento en la tecnología exponencial estrella.

Hace rato ya que las noticias sobre avances de la inteligencia artificial dejaron de causar sorpresa. La historia clásica de los sucesivos juegos en los cuales los algoritmos nos fueron ganando (ajedrez, go, videogames de estrategia de guerra) ya no son novedad. En cambio, la discusión pasó a "segundas derivadas" del fenómeno: la competencia geopolítica, los límites de esta tecnología, el riesgo de "antropormorfizarla", los cambios que ya está produciendo en habilidades humanas y la ya mencionada discusión por la causalidad.

Para expertos como Elias Bareinboim, Judea Pearl y Gary Marcus, la imposibilidad de la IA actual de entender la esencia del concepto de causalidad es la barrera a eliminar (entender que las nubes no sólo están correlacionadas con la lluvia, sino que son las que la provocan). Marcus propone correr el foco desde el "aprendizaje profundo" (deep learning) a uno de "entendimiento profundo". "El actual paradigma, que tiene demasiados datos pero poco conocimiento, razonamiento y modelos cognitivos, simplemente no nos está llevando a una IA en la que podamos confiar", sostiene el científico y divulgador.

La historia de los últimos diez años (y su perspectiva para el corto y mediano plazo) de la inteligencia artificial está muy bien resumida en el clásico Superpoderes de IA, de Kai-Fu Lee, que ya tiene un par de años. Lee cuenta que una década atrás el tema estaba visto como algo separado de la realidad y del campo de la ciencia ficción. Eso cambió radicalmente, en parte, según Lee, gracias a la victoria del algoritmo de DeepMind (la empresa inglesa de IA que fue comprada por Alphabet, el conglomerado de Google) en marzo de 2016 sobre el campeón humano de Go, Lee Sedol. Unos 230 millones de chinos siguieron el match entre la máquina y el campeón coreano y lloraron con el resultado. Para China fue, afirma Lee, un "momento Sputnik", similar a la herida de amor propio que se produjo en los estadounidenses en octubre de 1957, cuando se enteraron de que los soviéticos habían sido los primeros en colocar una persona en el espacio. El golpe fue tal que disparó una "fiebre de IA" en el estado y en las startups chinas, cuyo gasto acumulado el año pasado superó por primera vez (en este rubro) al de Estados Unidos.

¿Dónde estamos parados hoy? En una bisagra de elección y oportunidad, sostiene uno de los autores referentes de esta temática, Erik Brynjolfsson. "Pueden ser los diez mejores años de la historia de la humanidad o una de sus peores décadas, porque tenemos más poder en nuestras manos (con los desarrollos de IA) que nunca antes".

En un ensayo para Brookings, Indermit Gills junto a un equipo analizó el "TEG" de la batalla por el dominio de esta "tecnología de propósito general" entre los Estados Unidos, China y Europa. Hubo tres TPG anteriormente, y en cada una se fue reduciendo a la mitad el tiempo necesario para su expansión: 80 años para el motor de vapor, 40 años para la electricidad, 20 años para las PC y, probablemente, 10 años para la IA. La conclusión de este trabajo: quien esté a la vanguardia en 2030 será la potencia dominante en el resto del siglo. Gills apuesta por los Estados Unidos, cree que su cultura innovadora empresarial será una carta ganadora frente al poder de la planificación, el as de espadas chino.

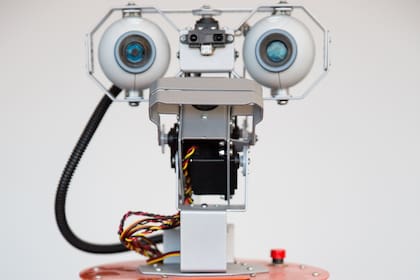

"Un problema habitual cuando se trata de medir el avance y el potencial de la IA es que se la compara todo el tiempo con la inteligencia humana. Esto lleva a muchos errores conceptuales, sobreestimaciones y subestimaciones por distintas avenidas. No debemos ?antropomorfizar' a la IA si queremos tener mejores pronósticos sobre lo que se viene en este campo", dice a la nacion Carlos Diuk, experto en ciencia de datos.

Para el tecnólogo y científico de datos Marcelo Rinesi, "lo profundamente transformador y lo que tiene más chances de serlo en un sentido positivo, es el tener inteligencias, incluso reducidas a habilidades o campos específicos, cualitativamente superiores a lo que ya podemos hacer. Hoy en día ya hacemos ciencia e ingeniería que son cognitivamente superhumanas, en el sentido de que son imposibles de hacer solo con humanos sin computadoras (incluyendo las computadoras que controlan los sensores, etcétera), pero pasando por cuellos de botella humanos y de grupos de humanos".

¿Qué nivel de cambios veríamos? Según Rinesi, "más o menos por definición, la diferencia entre la ciencia e ingeniería de, digamos, 1940, y la de 2020. Mi sospecha personal es que mucho de lo que imaginamos casi obligatoriamente en nuestro futuro (ingeniería genética, interfaces cerebro-máquina, niveles de vida altos para toda la población mundial) es imposible sin saltos en nuestra capacidad de hacer ciencia e ingeniería, lo que requiere el uso de herramientas super-humanamente capaces".

En un reciente ensayo titulado Mentes y máquinas, David Watson, de los Institutos de Internet de Oxford y Alan Touring sostuvo: "Es fácil pensar la inteligencia artificial en términos de la humana, antropomorfizarla. Imaginamos una amistad con Siri, un vehículo autónomo empático, y pensamos en algoritmos que aprenden igual que lo hacemos nosotros. Sin embargo, pensar que un ordenador tiene una inteligencia similar a la de un humano es erróneo y hasta puede resultar peligroso". Hacerlo, sigue Watson, implica introducir un sesgo que se va a quedar "corto" en pronósticos en algunas áreas de la inteligencia y que va a sobreestimar otras.

Jerome Pesenti, un ex-IBM que ahora lidera el laboratorio de IA de Facebook (creado años atrás por Yann Lecun, una figura legendaria en este terreno) admitió en una reciente entrevista: "El aprendizaje profundo y la actual IA, si uno es honesto, tienen un montón de limitaciones". Una de ellas, destaca, es que la actual dinámica de escalabilidad no es sostenible: la fuerza computacional que demandan hoy los experimentos más avanzados de IA se duplica cada tres meses y medio. "Si uno mira los experimentos top -explica el científico computacional-, cada año su costo se multiplica por diez. Hoy hay algunos proyectos que involucran valores de siete cifras (en dólares), pero pronto estaremos en el terreno de las 9 o 10 cifras, y eso no es posible, nadie lo puede costear. Significa que en algún punto vamos a chocar contra una pared; la batalla que se viene es por la optimización".

1

1Anses: cuándo cobro la jubilación de marzo si mi DNI termina en 7

- 2

Globant elogió el rumbo del Gobierno: “Si logramos que no sea un veranito, será difícil salir de esto”

3

3En medio de una situación asfixiante por la guerra, India le compra de emergencia gas a la Argentina

4

4A cuánto cotizó el dólar oficial y el dólar blue este miércoles 11 de marzo